Case Study

Entwicklung eines lokalen LLM‑Wissensmanagement‑Tools

Aufbau eines on‑premise Wissensmanagement‑Systems mit Retrieval‑Augmented Generation (RAG), das internes Wissen zuverlässig zugänglich macht und sensible Daten lokal verarbeitet.

Ausgangssituation

Wissen war über verschiedene Quellen verteilt, schwer auffindbar und oft nur über Experten zugänglich. Gleichzeitig bestand ein hoher Anspruch an Datenschutz und die Vermeidung von Cloud‑Abhängigkeiten.

- unstrukturierte Dokumente und Insellösungen

- hohe Such- und Abstimmungsaufwände

- vertrauliche Daten ohne Cloud‑Freigabe

- fehlende Wiederverwendbarkeit von Wissen

Ziel des Projekts

Entwicklung eines lokalen LLM‑Wissensmanagement‑Tools, das Antworten mit Quellenbezug liefert und organisatorisches Wissen zentral verfügbar macht.

- DSGVO‑konforme Verarbeitung lokaler Daten

- Unabhängigkeit von Cloud‑Anbietern

- nachvollziehbare Antworten mit Zitaten

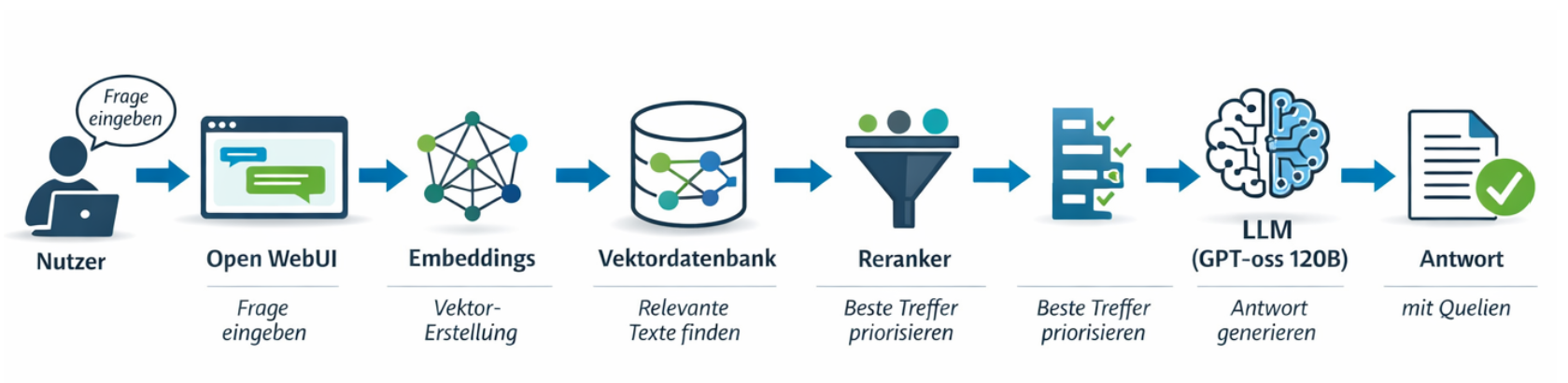

Systemarchitektur

Das System kombiniert eine Vektordatenbank mit einem Retrieval‑Layer und lokalen Open‑Source‑LLMs. Ein Reranker verbessert die Ergebnisqualität durch semantisches Re‑Ranking.

Datenaufbereitung

- Dokument‑Parsing und Normalisierung

- Chunking mit Überlappung für Kontextstabilität

- Metadaten‑Anreicherung für präzises Retrieval

- Versionierung und Qualitätschecks

Evaluationsansatz

- Relevanzmessung per Retrieval‑Metrics

- Human‑in‑the‑Loop‑Bewertungen

- Vergleich mit und ohne Reranking

Zentrales Ergebnis

Das lokale RAG‑System liefert verlässliche Antworten mit Quellenbezug und reduziert Suchzeiten deutlich. Der JINA Reranker verbessert die Trefferqualität spürbar, insbesondere bei mehrdeutigen Anfragen.

Mehrwert & Impact

- lokale Datenverarbeitung ohne Cloud‑Abfluss

- DSGVO‑konforme Wissensbereitstellung

- Unabhängigkeit von externen Anbietern

- schnellerer Zugriff auf Expertenwissen

- skalierbar für weitere Datenquellen

Projektfakten

- Domain

- Wissensmanagement

- Setup

- On‑Premise

- Stack

- Qdrant, RAG, JINA

- Output

- Quellen‑gestützte Antworten

Weiterführendes Material

Gern gebe ich Einblicke in Architektur, Retrieval‑Strategien und Evaluationsmethodik.